[우먼타임스 박성현 기자] 세계적으로 문제가 되고 있는 가짜 뉴스(fake news) 중에서 가장 심각한 것은 단순한 뉴스가가 아닌, 영상을 활용한 ‘딥페이크(deepfake)’ 기술이다.

인공지능 기술을 악용해 여성 연예인의 얼굴을 포르노 영상물에 합성해 인터넷에 유포한 딥페이크 범죄가 일본에서 처음 적발됐다고 일본 언론들이 30일 보도했다. 우리나라에서는 이미 이런 범죄가 있었다.

일본 언론에 따르면 도쿄도 경시청은 여성 연예인 딥페이크 음란물 영상을 제작 유포한 혐의로 두 명의 대학생을 명예훼손 및 저작권법 위반 혐의로 체포했다.

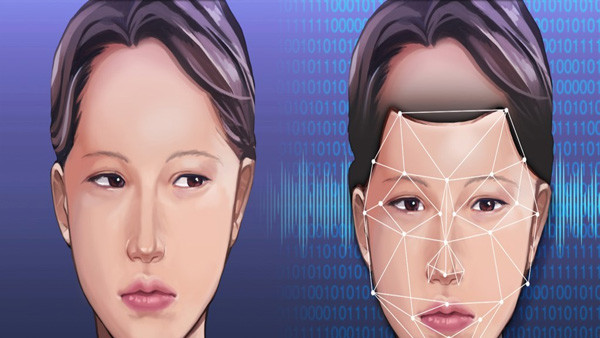

딥페이크란 ‘딥 러닝’(deep learning)과 ‘페이크’(fake·가짜)의 합성어로 인공지능 기술을 악용해 사람의 얼굴이나, 특정한 부위를 영화의 CG처럼 합성한 영상 편집물을 말한다.

딥페이크는 원본 영상과의 구분이 어려울 정도로 발전하고 있다. 발전된 합성 기술을 응용해 개인 컴퓨터로도 만들 수 있다. 그 대상은 주로 연예인으로 포르노 장르에 가장 자주 악용되고 있다. 그러나 최근 들어서는 정치적 또는 상업적 공격 목적으로 유명 정치인이나 기업을 타깃으로 제작되고 있어 큰 문제로 대두되고 있다. 한 순간에 평판이나 여론이 뒤엎어질 수 있는 것이다.

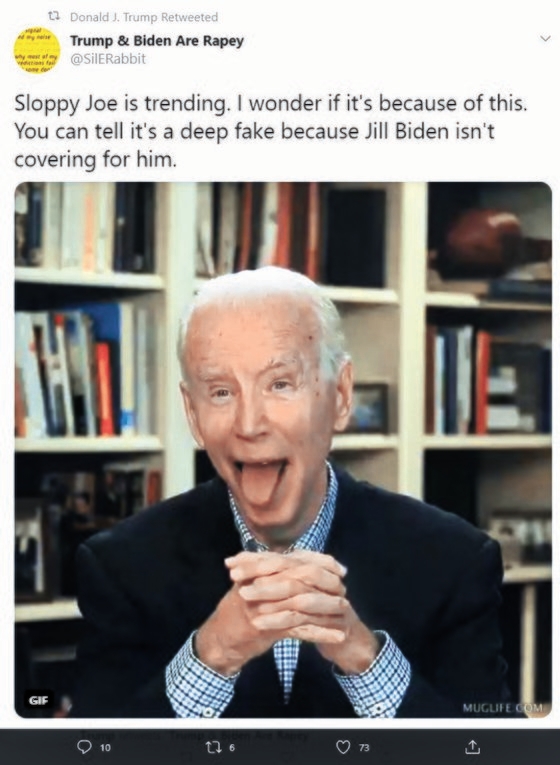

대선을 앞두고 미국에서는 정치인 얼굴을 합성 영상으로 만들어 가짜 뉴스를 생성하기도 했다.

일반인 또한 딥페이크에서 자유로울 수가 없다. 자기가 싫어하는 사람이나 헤어진 연인 얼굴을 합성해 복수하는 ‘리벤지 포르노’가 적발된 사례도 나오고 있다.

딥페이크는 사이버 명예훼손죄나 음란물 유포죄로 형사 처벌이 가능하다. 초상권 침해에도 해당된다. 국내는 3월에 관련 법안이 통과돼 성폭력범죄의 처벌 등에 관한 특례법 위반으로 처벌받는다.

방송통신위원회는 지난 6월 한국 연예인 영상을 음란물과 합성해 유통한 해외 딥페이크 사이트와 소셜 미디어 계정 52건을 찾아내 시정을 요구하고 접속을 차단한 적이 있다.

딥페이크 포르노 동영상은 세계적으로 2017년 처음 발견된 이후 확산하는 추세다. 네덜란드 사이버 보안기업 딥 트레이스는 2019년 한 해에 1만 4,000여 건의 딥페이크를 찾아냈는데 전년 대비 84%나 급증했다. 이 회사 보고서에 따르면 여러 각도에서 찍은 사진 250장만 있으면 이틀 안에 딥페이크 포르노를 제작할 수 있다.